「自分だけの特化型AIを開発したい。でも、クラウドサービスは高価だし、環境構築も複雑でハードルが高い…」多くの開発者やクリエイターが、このような悩みを抱えているのではないでしょうか。AIのカスタマイズ、特にファインチューニングは、これまで高性能なクラウドGPUが必須と考えられてきました。しかし、その常識は今、大きく変わろうとしています。

その変革の主役が、Appleの最新チップ「M4」を搭載したMacBook Proです。Apple Siliconの進化により、あなたの手元にあるMacBook Proが、パワフルなAI開発マシンへと変貌を遂げるのです。本記事では、MacBook Pro M4を使って、ローカル環境でAIモデルのファインチューニングを行うための具体的な手順を、ゼロから徹底的に解説します。

ローカル環境での開発には、クラウドにはない数多くの魅力があります。外部サーバーにデータを送信しないことによる高いセキュリティ、インターネット接続が不要なオフラインでの利用可能性、そして何より、コストを気にせず何度でも試行錯誤できる手軽さです。この記事を読み終える頃には、あなたも自分だけのAIを育てる第一歩を踏み出していることでしょう。

MacBook Pro M4はAIファインチューニングに耐えられるのか?

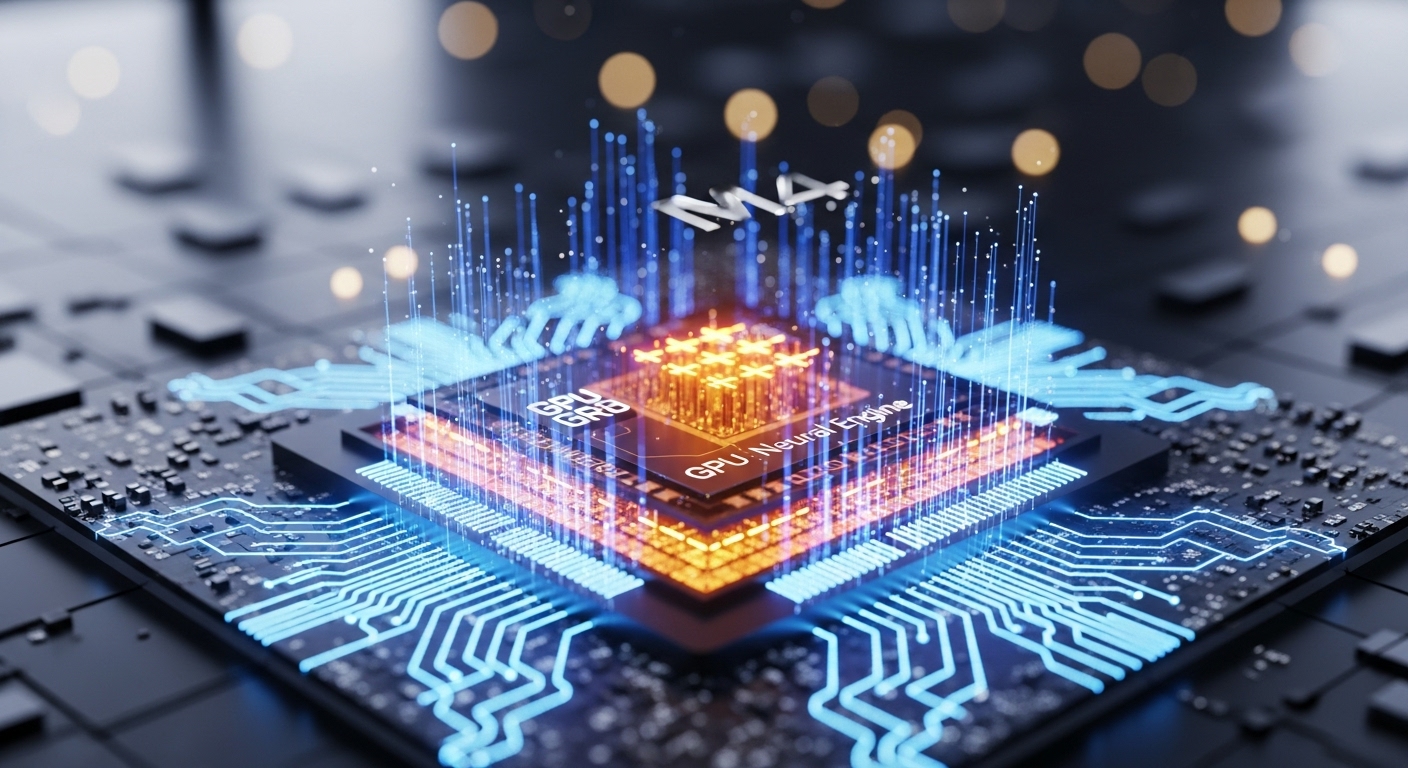

まず最も気になるのが、「MacBook Pro M4の性能で、本当にAIのファインチューニングなんて重い処理が可能なのか?」という点でしょう。結論から言えば、答えは「イエス」です。その鍵を握るのが、Apple Siliconの根幹をなすユニファイドメモリアーキテクチャです。

従来のPCでは、CPUとGPUが別々のメモリを持っており、両者間でデータをコピーする必要がありました。これはAIの学習のように大量のデータをやり取りする処理では大きなボトルネックになります。しかし、ユニファイドメモリはCPU、GPU、そしてAI処理専門のNeural Engineが単一のメモリプールを共有するため、データのコピーが不要になり、驚異的な効率と速度を実現します。M4チップではこのメモリ帯域幅がさらに向上し、大規模なAIモデルをよりスムーズに扱えるようになると期待されています。

では、具体的にどれくらいのスペックが必要でしょうか。ファインチューニングしたいモデルのサイズによりますが、一つの目安として以下を推奨します。 - 最低ライン: 16GBのユニファイドメモリ。比較的小さなモデル(例:3Bパラメータ以下)の実験的なファインチューニングが可能です。 - 快適な開発: 32GB以上のユニファイドメモリ。現在主流となっている7B(70億)パラメータクラスのモデルを、LoRAなどの効率的な手法でファインチューニングするなら、このラインが現実的です。より大きなモデルに挑戦したい場合は、64GBや128GBを選択することで、開発の幅が大きく広がります。

もちろん、NVIDIAのA100やH100といった最高峰のクラウドGPUと比較すれば、純粋な計算速度では及びません。しかし、MacBook Pro M4でのローカル開発は、セットアップの圧倒的な手軽さ、月額数万〜数十万円かかるクラウドコストからの解放、そしてアイデアを即座に試せる俊敏性といった、総合的な開発体験において大きなアドバンテージを持っています。

環境構築の「正解」- Apple純正フレームワークMLXを使いこなす

MacBook Proの性能を最大限に引き出すためには、適切なソフトウェア、つまりフレームワークの選択が不可欠です。そこでおすすめするのが、Appleが自ら開発したApple Silicon向け機械学習フレームワーク「MLX」です。

MLXは、PyTorchやTensorFlowといった既存のフレームワークに似たAPIを持ちながらも、Apple Siliconのユニファイドメモリアーキテクチャを最大限に活用するよう設計されています。PyTorchがGPUメモリ(VRAM)を意識したコーディングを必要とするのに対し、MLXはメモリ管理をフレームワーク側で最適化してくれるため、開発者はよりシンプルにモデルの構築と学習に集中できます。まさにApple Siliconのための最適解と言えるでしょう。

それでは、実際にMLXを使った環境構築をステップ・バイ・ステップで進めていきましょう。macOSには標準でPythonがインストールされていますが、バージョン管理の観点からHomebrewを使って新しいPython環境を構築することをお勧めします。

1. Homebrewのインストール(未導入の場合): ターミナルを開き、公式サイトのコマンドを実行します。 2. Pythonのインストール: `brew install python` を実行し、最新のPythonをインストールします。 3. 仮想環境の作成: `python3 -m venv mlx-env` で仮想環境を作成し、 `source mlx-env/bin/activate` で有効化します。 4. MLXのインストール: 準備が整ったら、いよいよMLXをインストールします。以下のコマンドを実行するだけです。 `pip install mlx mlx-lm` `mlx-lm`は、大規模言語モデルの学習や推論を簡単に行うためのヘルパーライブラリです。

インストールが完了したら、`python -c "import mlx.core as mx; print(mx.array([1, 2, 3]))"` のような簡単なコマンドを実行して、MLXが正しく動作することを確認しましょう。エラーが出なければ、あなたのMacBook ProはAI開発のための強力な基盤を手に入れたことになります。

実践!自分だけの特化型AIを育ててみよう

環境が整ったところで、いよいよファインチューニングの実践です。今回は、限られた計算リソースでも効率的に学習できる「LoRA(Low-Rank Adaptation)」という手法を用います。これは、モデルの全パラメータ(数十億個!)を更新するのではなく、ごく一部の追加パラメータだけを学習させることで、メモリ消費を劇的に抑える技術です。さらに量子化技術を組み合わせたQLoRAは、より少ないメモリでファインチューニングを可能にします。

ここでは、MLXのサンプルライブラリである`mlx-examples`(`mlx-lm`に統合)を使い、具体的な手順を見ていきましょう。このツールを使えば、コマンド一つで複雑なファインチューニングを実行できます。

ステップ1:ベースモデルの選定とダウンロード まずは、ファインチューニングの土台となる「ベースモデル」を決めます。Hugging Face Hubには、Metaの「Llama 3」やGoogleの「Gemma」など、オープンソースの高性能なモデルが多数公開されています。今回は比較的小さく扱いやすいモデルを選ぶと良いでしょう。モデルは`mlx-lm`が自動でダウンロードしてくれます。

ステップ2:データセットの準備 AIに特定のタスクを教えるための「教科書」となるのがデータセットです。これはファインチューニングの成否を分ける最も重要な要素です。データは、`{"text": "学習させたい文章"}` のような形式のJSONオブジェクトを1行に1つずつ記述したJSONL形式で準備します。例えば、特定の文体や専門知識を教えたい場合は、関連する文章を大量に集めてこの形式に整形します。

ステップ3:学習コマンドの実行 データセットの準備ができたら、ターミナルで以下のコマンドを実行して学習を開始します。`mlx_lm.lora`コマンドは、多くの設定を自動で行ってくれるため非常に便利です。

`mlx_lm.lora --model [ベースモデル名] --train --data [データセットのパス] --adapter-path ./my-adapter --iters 600` このコマンドは、指定したベースモデルを、あなたのデータセットで600イテレーション(反復学習)するという意味です。学習が始まると、MacBook Proのファンが回りだし、M4チップがフル稼働していることを実感できるはずです。

ステップ4:アダプタの結合とモデルの保存 学習が完了すると、`my-adapter`というディレクトリに「アダプタ」ファイルが生成されます。これは、LoRAによって学習された差分データです。これをベースモデルに統合(フュージョン)することで、あなただけのカスタムモデルが完成します。統合も専用のコマンドで簡単に行え、ファインチューニングされた新しいモデルとして保存できます。

ファインチューニングしたモデルを「使う」

モデルを育てるだけでは終わりません。その能力を実際に活用してこそ、ファインチューニングの価値が生まれます。幸い、作成したモデルをローカルで手軽に試すための素晴らしいツールが存在します。

その一つが「Ollama」です。Ollamaは、様々な大規模言語モデルをローカル環境で簡単に実行するためのツールです。あなたがファインチューニングしたモデルも、簡単な手順でOllamaに登録し、ターミナルやサードパーティ製のWeb UIから対話形式で性能をテストできます。これにより、「特定の質問に対して、意図した通りの回答を生成するか」といった評価を直感的に行えます。

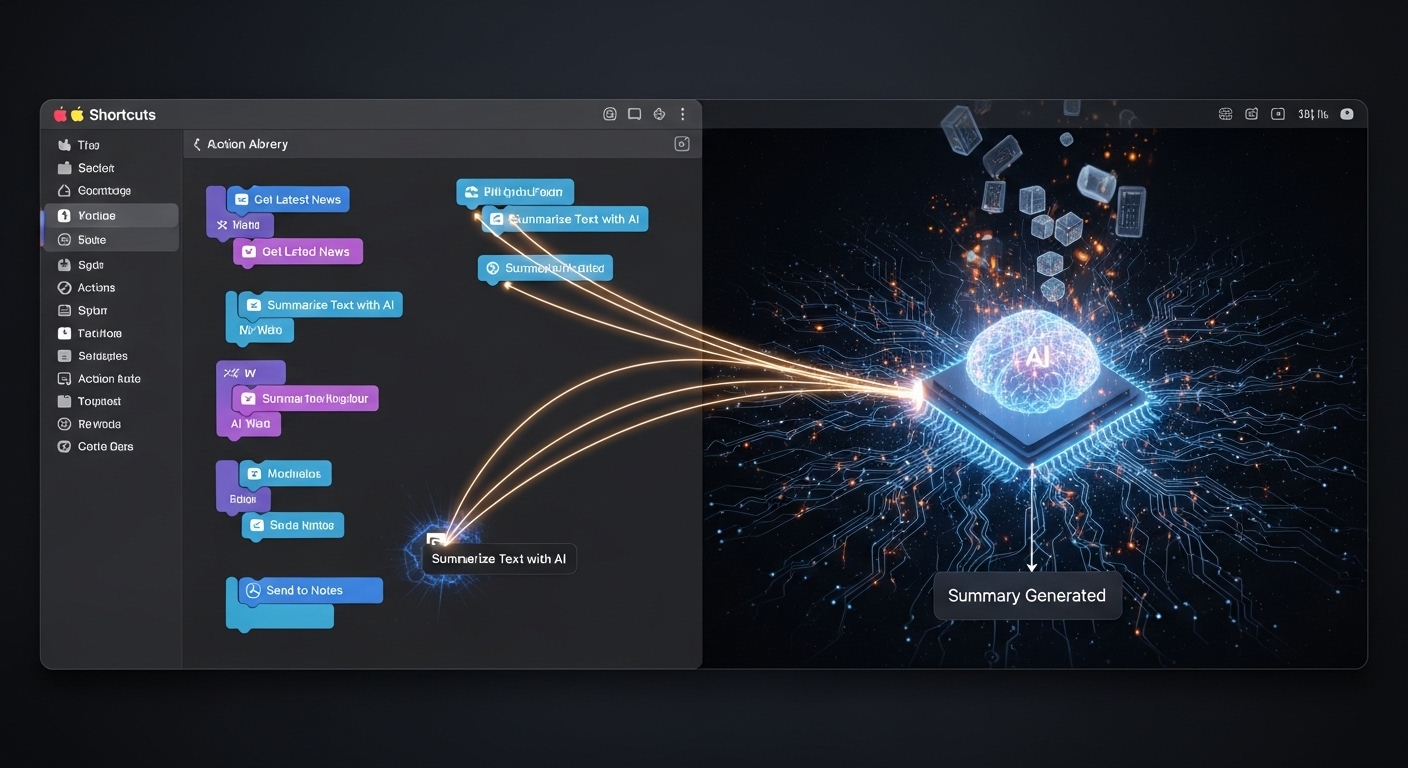

さらに実用的な応用例として、macOSとの連携が挙げられます。例えば、以下のような活用が考えられます。 - ショートカットアプリとの連携: 定型的なメールの文章作成や、テキストの要約といったタスクを、自作AIを呼び出すショートカットとして登録し、ワンクリックで実行する。 - Pythonスクリプトからの利用: Pythonスクリプトにモデルを呼び出す処理を組み込み、ファイル整理やデータ分析などの作業を自動化する。他のアプリケーションとの連携も自由自在です。

また、「コマンドライン操作は少し苦手…」という方でも心配は無用です。LM StudioのようなGUIツールを使えば、モデルのダウンロードからファインチューニング、チャットでの実行まで、ほとんどの操作をマウスで行うことができます。AI開発の敷居は、驚くほど低くなっているのです。

まとめ:M4 MacBook Proは、AI開発のゲームチェンジャーである

本記事では、MacBook Pro M4とApple純正フレームワークMLXを用いて、ローカル環境でAIモデルのファインチューニングを行う方法を、環境構築から実践、そして活用まで一気通貫で解説しました。もはやAI開発は、一部の専門家や巨大IT企業だけのものではありません。

重要なポイントを振り返りましょう。 - ユニファイドメモリ: M4チップのユニファイドメモリアーキテクチャは、データのボトルネックを解消し、MacBook Proを強力なAIマシンに変える。 - MLXフレームワーク: Apple Siliconに最適化されたMLXは、開発者がハードウェアを意識することなく効率的な開発を可能にする。 - 効率的な手法: LoRA/QLoRAのような手法を用いることで、限られたリソースでも高性能なモデルのカスタマイズが実現できる。 - 手軽な活用: Ollamaや各種ツールを使えば、作成したモデルをすぐに試し、日々のワークフローに組み込むことができる。

Apple Siliconの進化は、これからも続いていくでしょう。AI開発は、ますますパーソナルで、手元のデバイスで完結する時代へとシフトしていきます。ファインチューニングはゴールではなく、新たな創造のスタート地点です。この記事を参考に、ぜひあなただけのユニークなAIアプリケーション開発に挑戦してみてください。M4 MacBook Proは、そのための最高の相棒となるはずです。